美國當地時間1月5日,在超威半導體AMD CEO蘇姿豐即將在CES開幕前夜主題演講的幾個小時前,英偉達CEO黃仁勛率先在不遠的酒店舉行新年的第一場演講。

當天上午11點,距離英偉達發布會正式開始還有3個多小時,第一財經記者看到,在拉斯維加斯楓丹白露酒店的劇場中心外,觀眾已經開始排起了百米長隊。

3000人的劇場座無虛席,黃仁勛一身閃亮的皮衣入場,發布了多款與物理AI有關的開源模型,同時首次詳細披露了新一代芯片平臺Rubin的性能數據。

此外,還有一系列機架產品、超節點產品發布。從新發布的產品看,英偉達不再只依賴芯片上晶體管密度提升,而是著力網絡處理、低精度浮點運算、數據中心超節點等方面,來綜合提升算力。黃仁勛還在演講中展望了自動駕駛汽車加速到來的前景。

物理AI是黃仁勛演講的重中之重。他說,英偉達已為物理AI工作了8年。現場演示視頻中,來自黃仁勛的聲音說:物理AI的ChatGPT時刻即將到來。

點贊中國DeepSeek

一開場,黃仁勛指出,計算機行業每10到15年就會經歷一次平臺變革,從大型機,PC,互聯網到云計算和移動端,每次都會催生新的應用生態。但這次不同,AI和計算架構正在同時發生雙重變革。

AI本身既是應用又是新平臺,開發者將在AI之上構建更多應用。更關鍵的是軟件開發范式被徹底顛覆:從編寫代碼轉向訓練模型,從預編譯執行轉向實時生成。這意味著整個計算機技術棧正在被重構,每一次交互都是全新的動態生成過程。

他透露,在英偉達內部,AI編程應用cursor已經徹底改變了公司進行軟件編程的方式 。

黃仁勛指出,加速計算和人工智能正在徹底重塑計算領域的每個層面。這意味著過去十年價值約10萬億美元的計算基礎設施正在進行現代化改造,每年還有數千億美元的風投資金涌入這一領域。

更關鍵的是,全球100萬億美元的產業正在將研發預算從傳統方法轉向人工智能。當人們疑惑資金從何而來時,答案正是來自AI的現代化改造,以及研發預算的戰略性轉移。

他還總結,去年行業最重要的改變之一就是開源模型真正起飛。他專門提到中國的DeepSeek R1,稱該模型讓世界為之驚訝,并真正激活了這場全球性的開源運動,并且它們的性能越來越逼近領先的前沿模型。

在他身后的PPT上,展示了多個開源模型,其中包括三個中國開源模型,分別是Kimi K2、Qwen、DeepseekV3.2 。

自動駕駛汽車拐點

黃仁勛認為,AI發展的下一站是進入物理世界。英偉達已為此工作了8年。

核心挑戰在于,如何讓AI獲得對物理世界的“常識”——物體恒存性、因果性、摩擦力、重力、慣性等對人類孩子而言自然的認知,對AI卻完全陌生。

為此,英偉達建立一個系統,讓AI學習物理世界的常識。這需要三臺計算機,一臺訓練AI,一臺用來模擬,一臺在機器中運行。合成數據的方式則能以物理定律為基礎,生成一些數據來訓練AI。

“仿真是英偉達幾乎所有物理AI工作的核心。”黃仁勛強調。這一多層次的技術棧,正推動AI從屏幕內的對話者,轉變為能夠在現實世界中執行任務的行動者。

一個最被看好的落地場景就是自動駕駛。

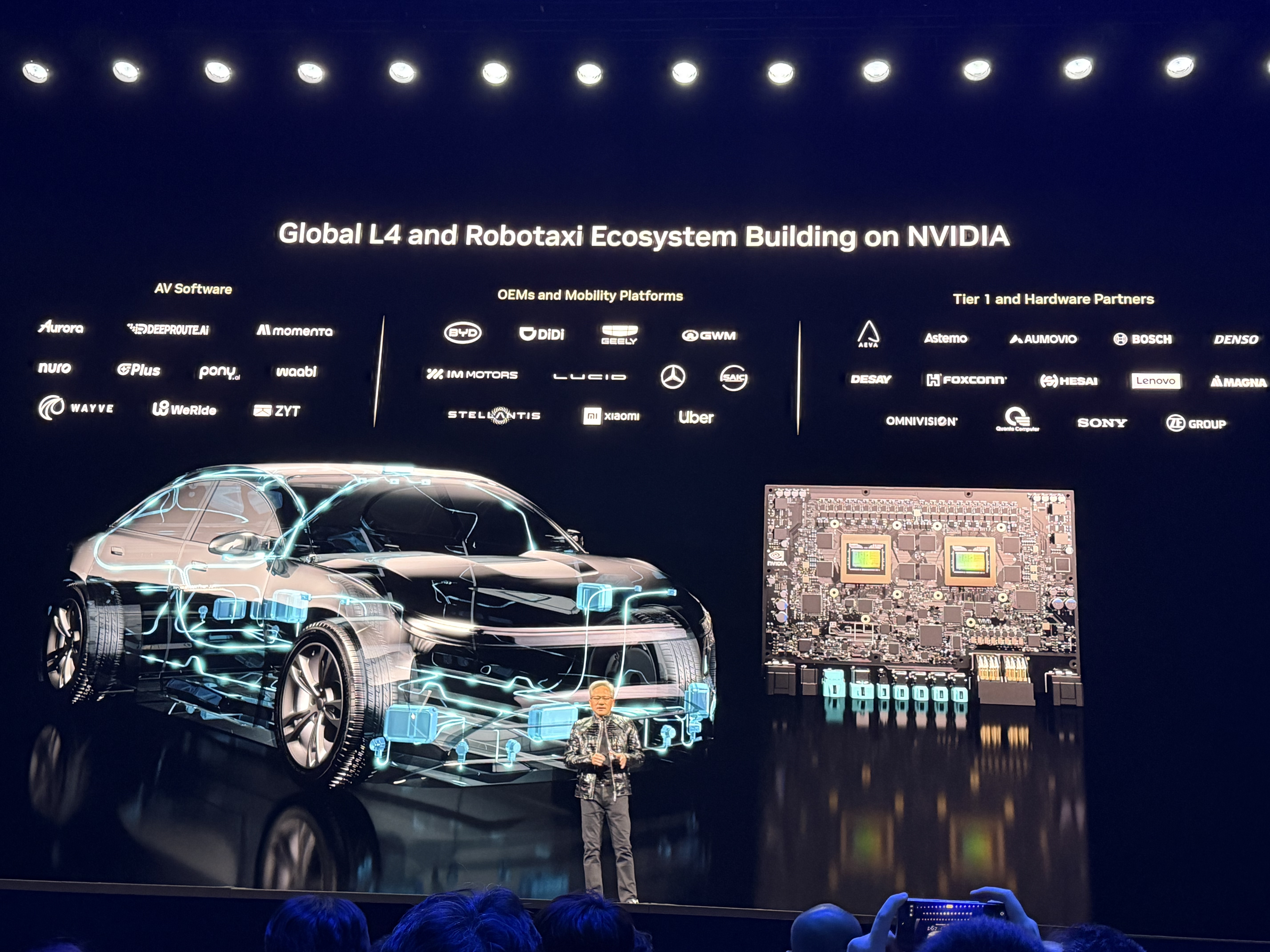

“我想我們都同意,從非自動駕駛汽車到自動駕駛汽車的轉折點,可能就發生在這個時候。”黃仁勛表示,未來十年里,可以相當肯定,世界上很大一部分汽車將是自動駕駛或高度自動駕駛的。

黃仁勛表示,英偉達此前推出的Cosmos世界基礎模型下載次數已達到數百萬次。此次英偉達推出開源推理VLA模型Alpamayo,該模型系列包含開源AI模型、仿真工具和數據集,可加速基于推理的、安全的自動駕駛車輛開發,這是英偉達AV團隊數千人的工作成果。

據介紹,英偉達DRIVE AV軟件將在梅賽德斯奔馳車輛上使用,相關的AV自動駕駛汽車剛投入生產。第一輛AV自動駕駛汽車將在今年第一季度在美國上路,第二季度進入歐洲,第三或第四季度進入亞洲。英偉達還將繼續更新版本,合作建造L4 Robotaxi的生態系統還在擴大。

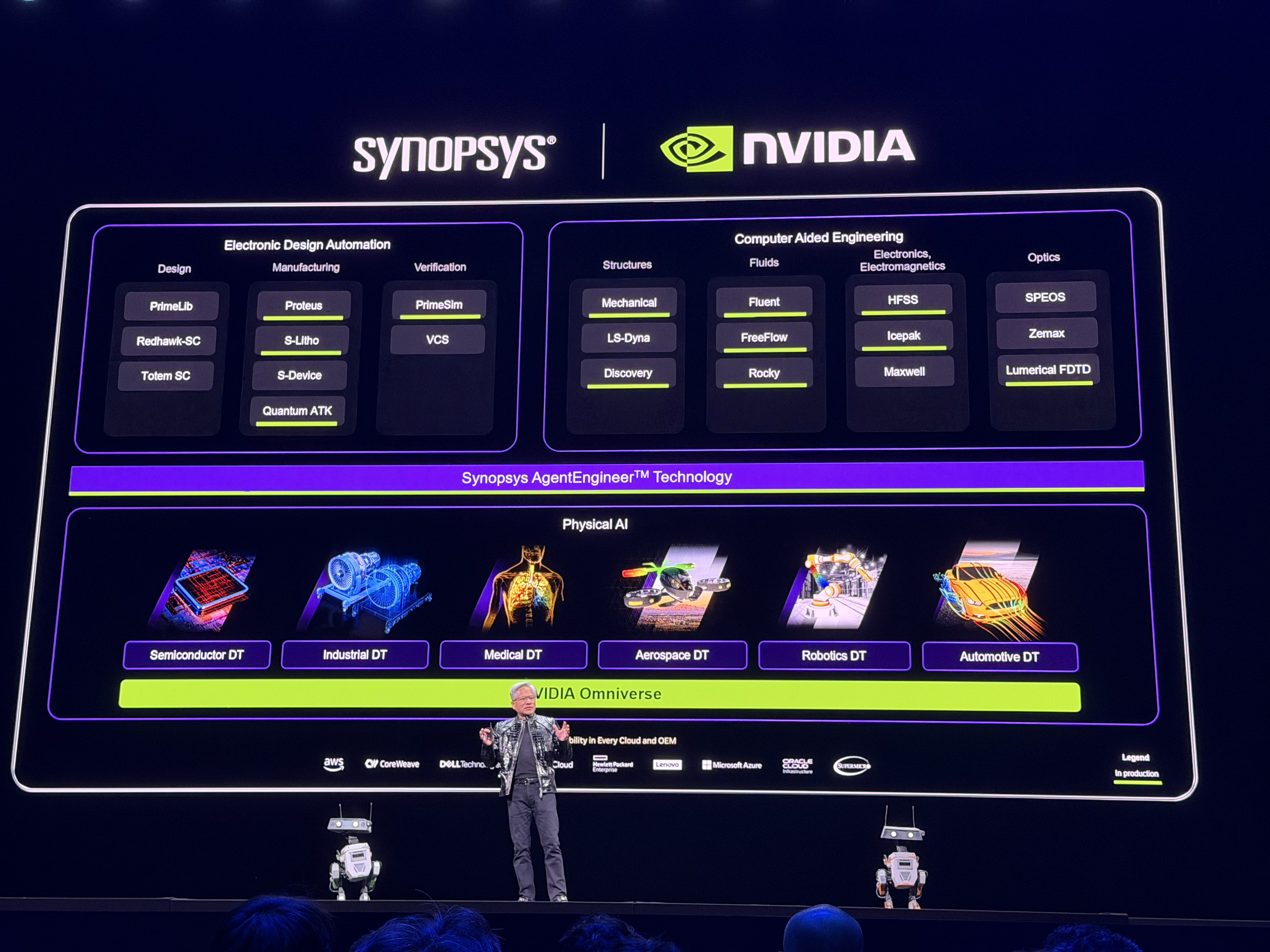

工業制造是物理AI的另一核心戰場。黃仁勛宣布了與西門子深化合作,將英偉達的物理AI模型、Omniverse仿真平臺集成至西門子的工業軟件組合,覆蓋從芯片設計、工廠模擬到生產運營的全生命周期。

“我們正站在一場新工業革命的開端,”他表示。物理AI將賦能芯片設計、生產線自動化乃至整個數字孿生系統,實現“在計算機中設計、在計算機中制造”。

機器人方面,黃仁勛稱,機器人系統的下一段征程是機器人,這些機器人會有不同的尺寸。一些與機器人相關的開源模型也在今日推出,包括Cosmos Transfer 2.5和Cosmos Predict 2.5世界模型、面向智能機器人的推理視覺語言模型(VLM)Isaac GR00T N1.6等,還有多個用于機器人開發的新開源框架。

Rubin芯片全面生產

英偉達每年更新一代的芯片平臺,也披露了一些新信息。黃仁勛表示,Rubin平臺包含六款新芯片,分別是Vera CPU、Rubin GPU、NVLink 6交換機芯片、ConnectX-9 Spectrum-X超級網卡芯片、BlueField-4 DPU、Spectrum-6以太網交換機芯片。

其中,Rubin GPU的NVFP4(4位浮點數格式)推理算力為50PFLOPS,是Blackwell的5倍;NVFP4訓練算力是35PFLOPS,是Blackwell的3.5倍;HBM4內存帶寬22TB/s,是Blackwell的2.8倍,晶體管數量3360億個,是Blackwell的1.6倍。與Blackwell平臺相比,Rubin平臺通過軟硬件協同設計,將推理token成本降低10倍,將訓練MoE模型(專家模型)所需的GPU數量減少4倍。

“如果我們不做協同設計,即便在每年提升1.6倍晶體管數量的最好情況下,以及在每個晶體管性能提升一些,例如提升25%的情況下,也難以獲得巨大的性能提升。”黃仁勛表示,這就是為什么要做另外一些事情,例如推出NVFP4,以便在可以損失精度的地方實現更高的吞吐量。這種協同設計,使新的芯片平臺可以有比較大的性能提升。

其他新芯片中,ConnectX-9 Spectrum-X超級網卡芯片有230億個晶體管,支持800 GB/s以太網;BlueField-4 DPU有1260個晶體管,網絡能力、計算能力和內存帶寬是上一代BlueField-3的2倍、6倍、3倍;Spectrum-X 以太網共封裝光學器件有3520億個晶體管,可支持102.4 Tb/s橫向擴展交換基礎設施。

黃仁勛表示,ConnectX-9 Spectrum-X改變了以太網被AI所使用的方式。此前英偉達推出Spectrum-X平臺,可用于提高數據中心網絡吞吐量,但隨著人們與AI進行長時間對話,需要的記憶量快速增長,當大量AI同時運行,網絡還是顯得不夠快。AI實驗室和云服務提供商都遭受了大量網絡流量帶來的困擾。因此英偉達推出了推理上下文內存存儲平臺,作為一種新型的AI存儲基礎設施,并由BlueField-4 DPU提供支持,BlueField-4 DPU可為AI基礎設施提供單一、可信的控制點,以便配置、隔離和運營大規模AI環境。

新一代NVLink72、新一代超節點DGX SuperPOD的性能數據也在此次演講中公布。其中,NVLink72是一種機架級擴展系統,通過整合多個CPU、GPU等形成單一較高效率的加速單元。

據介紹,Rubin平臺采用新的Vera Rubin NVL72。Vera Rubin NVL72的NVFP4推理和訓練算力分別是3.6EFLOPS、2.5EFLOPS,分別是Blackwell的5倍和3.5倍。HBM4內存帶寬1.6PB/s,是Blackwell的2.8倍,晶體管數量220萬億個,是Blckwell的1.7倍。黃仁勛表示,相比使用Blackwell NVL72,使用Rubin NVLink72去訓練模型,其他條件相同的情況下,所需GPU數量是前者的1/4,思考輸出的token數量則是10倍。此外,DGX SuperPOD由一個超節點整合8個Rubin NVL72機架中的576顆GPU,產品將于今年下半年上市。

英偉達透露,Rubin平臺產品已全面投入生產。基于NVIDIA Rubin的產品則將于2026年下半年由合作伙伴推出。首批使用Rubin的云服務提供商包括AWS、谷歌云、微軟等。Anthropic、OpenAI、xAI等AI實驗室也將使用Rubin提供的算力。

幫企客致力于為您提供最新最全的財經資訊,想了解更多行業動態,歡迎關注本站。鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播更多信息之目的,如作者信息標記有誤,請第一時間聯系我們修改或刪除,多謝。