1月1日消息,DeepSeek趕在新年前發送了“賀禮”,在新論文中提出了名為mHC(流形約束超連接)的新網絡架構,旨在解決傳統架構在大規模模型訓練中的不穩定性問題,這一研究或將為下一代基礎架構的演進指明新方向。

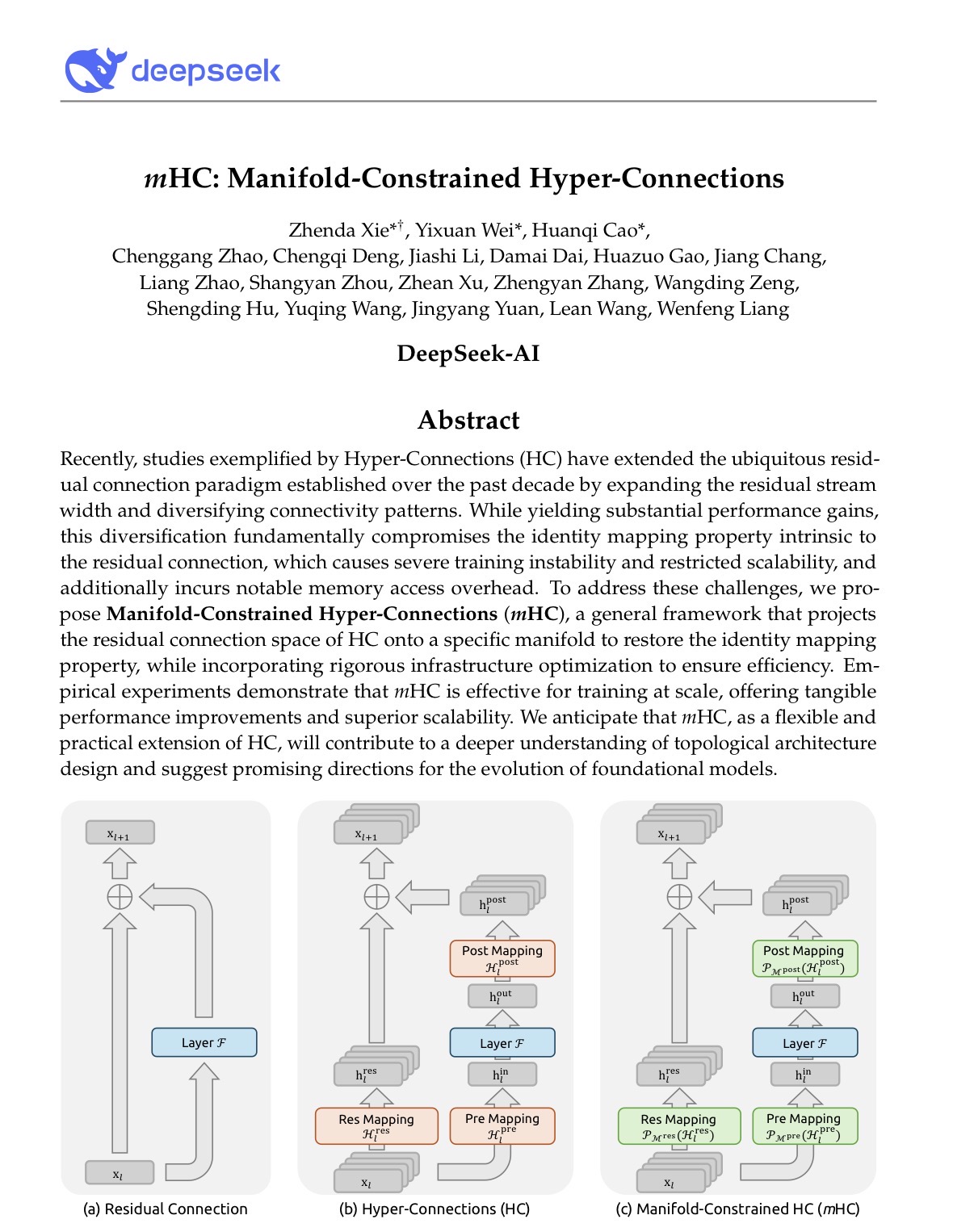

新論文名為《mHC :Manifold-Constrained Hyper-Connections》(《mHC:流形約束超連接 》),DeepSeek創始人兼CEO梁文鋒出現在了合著名單之中,而解振達(Zhenda Xie)、韋毅軒(Yixuan Wei)、曹煥琪(Huanqi Cao)則是核心貢獻者。

近年來,以超連接(HC)為代表的研究拓展了過去十年確立的通用殘差連接范式(深度神經網絡的經典連接范式),靠拓寬神經網絡的“信息傳輸通道”、增加通道間的連接,讓模型性能變好。但這種多樣化也導致了大規模訓練中的不穩定性、可擴展性受限及內存訪問開銷大的問題。

因此,DeepSeek這篇論文針對超連接架構這些問題,提出兼顧性能與效率的改進框架,即mHC 架構,這類似于給超連接的“信息通道”加了一套“交通規則”,在保留性能優勢的同時,又恢復了信息原樣傳遞的特性,讓模型訓練更穩定、更容易做大,從而推動大模型底層架構的工業化落地。

這一論文整體較為技術,但通俗來講,如果將AI模型想象成一個很長的“計算鏈條”,傳統計算鏈條的問題在于,傳遞信息時是一條窄窄的管道,信息量大了就會“堵車”。后來的方法是將管道加寬(超連接),信息流更多,但水流太猛有時候會把水管沖壞。DeepSeek提出的mHC相當于給水管加了“智能調節閥”,能確保水流的穩定,運行的時候更省資源。

在論文中,DeepSeek表示,mHC為未來研究開辟了多個前景廣闊的路徑。研究團隊希望mHC能重新激發學界對宏觀架構設計的興趣。通過深化對拓撲結構如何影響優化與表征學習的理解,mHC或將有助于突破當前限制,并可能為下一代基礎架構的演進指明新方向。

從行業意義上來看,mHC或許能讓企業在訓練更大規模的基礎模型時,減少硬件投入、縮短訓練周期。比如算力有限的中小AI企業,也能嘗試開發更復雜的大模型,降低了大模型研發的門檻。此外,訓練穩定性和可擴展性的提升,能讓大模型在更復雜的場景落地,比如需要超大規模參數的多模態模型、工業級的智能決策系統。

有行業人士評價認為,DeepSeek這一研究是底層創新,這次創新的架構看向的是Transformer最基礎的問題,結合此前的積累,他預測DeepSeek 有望在V4版本中做出重大的更新。

自2025年初引發廣泛關注以來,這一年DeepSeek雖未正式推出R2或V4等重大版本,但在模型迭代與開源上持續發力:僅12月就同步推出了DeepSeek-V3.2與V3.2-Special,11月底也開源了數學推理模型DeepSeek-Math-V2,成為目前首個達到國際奧數金牌水平并開放使用的數學模型。

幫企客致力于為您提供最新最全的財經資訊,想了解更多行業動態,歡迎關注本站。鄭重聲明:本文版權歸原作者所有,轉載文章僅為傳播更多信息之目的,如作者信息標記有誤,請第一時間聯系我們修改或刪除,多謝。